最近关注车圈的车友应该都被“智能化”这个词刷屏了,尤其当小编实地参观了上海车展后,更是被众多车厂销售口中的智能化无人驾驶解决方案渲染的“头晕眼绚”。也在考虑要不要买一辆具备一定无人驾驶能力的智能化电动汽车了。

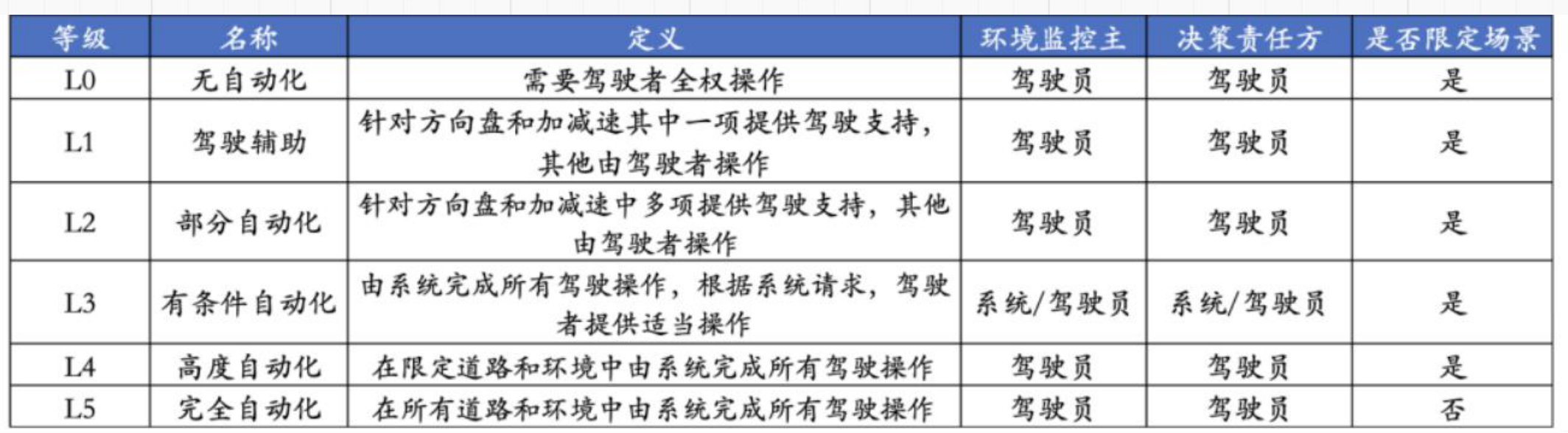

别急,仔细研究了一番无人驾驶行业的全景图后,小编从中总结了无人驾驶技术最为重要的几项细分技术,以及未来无人驾驶技术的发展趋势。希望本篇的分析对于对无人驾驶技术感兴趣的小伙伴以及有意购买下一辆具备无人驾驶能力的智能汽车的人提供一些思考和建议。先说结论:目前市面上众多车厂的无人驾驶解决方案中还没有哪一家真正意义上实现了L3级别的驾驶能力。温故而知新,让我们来复习一下无人驾驶技术不同级别的含义:

也就是说,当前车企中没有哪一家敢说我可以闭着眼让你开车,即使强如特斯拉都没有达到L3级别的能力。所以消费者在考虑购买下一辆智能化汽车的时候记住不论商家把其无人驾驶功能包说的多么天花乱坠、神乎其神,你只需问他一句:达到全域L3级别的驾驶能力了吗?有国家给的无人驾驶L3级的认证吗?

当前市面所有无人驾驶车厂的解决方案均为达到真正意义上的L3级

在探究无人驾驶技术未来的发展之前,先思考下对于自动驾驶技术最为关键的技术因素有哪些?从技术角度讲,所有自动驾驶解决方案厂商均依赖于人工智能算法的先进性和高效的架构作为其无人驾驶平台的底层逻辑,而人工智能算法中最适合无人驾驶解决方案的是深度学习(Deep Learning)算法。所谓深度学习,就是让计算机从经验中学习,并根据层次化的概念体系来理解世界,而每个概念则通过与某些相对简单的概念之间的关系来定义。 深度学习依赖于深度学习神经网络,我们先用大白话聊一聊什么是神经网络,然后再介绍为什么要把神经网络做“深”呢?相信看完本文之后就能理解什么是深度学习了。

从系统角度出发,一个系统通常有三个部分组成:输入、输出和模型。

输入和输出比较好理解,那么模型是什么呢?简单的说,模型就是输入和输出之间的映射关系。

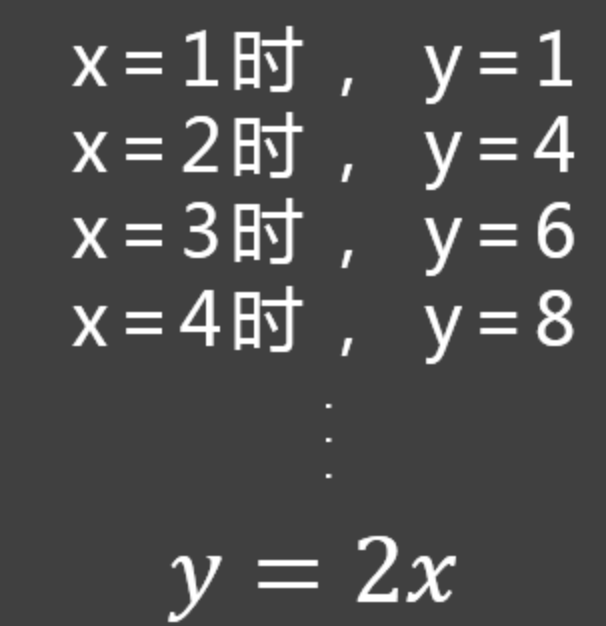

先拿一个最简单的例子来说:一个系统的输入是X,输出为Y,我们知道x=1,y=2;x=2,y=4;以此类推。我们很容易就得出x与y之间的映射关系,即y是两倍的x,即y=2x。

这个例子比较简单,我们一眼就能看出输入和输出之间的关系,当x为图片、声音、股市交易单、人口与房价等等复杂的输入时,如何计算出想要的输出y呢?

这时候就很明确了,从输入推理出输出的关键就在于,获取输入和输出之间的映射关系,我们将输入和输出之间的映射关系定义成一个函数 Y=F(x,0),这里的Y就是输出,x是输入。

关键就在于,怎么求解这个F呢?这时候就要祭出神经网络了,它的作用就是通过调整参数来求解输入输出之间的映射关系F。

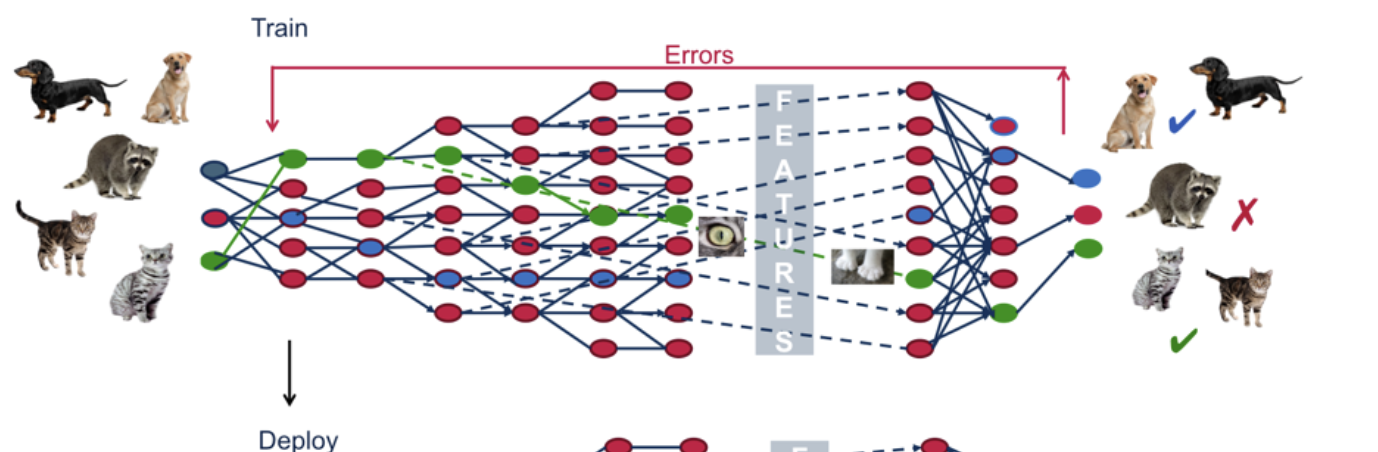

从理论上来讲,神经网络通过调整各层的参数0,可以拟合任意复杂度的函数。我们先喂给神经网络一定量的输入输出数据,通过一次次的训练,让网络学习到当前输入输出数据之间的映射关系。那么如果未知的输入X与训练神经网络的输入服从同分布的话,将这个未知输入X送入神经网络中就能够映射出一个输出Y。

神经网络就get到预测的能力了!

可是这种映射的结果一定是准确的吗,比如我输入一张猫咪的图像进入识别动物的神经网络,我想要的输出结果是:这是一只猫咪。但神经网络给出的输出有可能是:这是一只狗狗或者是一只猫猫。

这些基于神经网络的深度机器学习算法的性能在很大程度上依赖给定数据的表示(或者说“参照物”),深度学习算法通过不断类比和穷举其他较简单的表示(参照物),经过对决策标识的融合后来表达复杂表示。

此外,自动驾驶技术依赖外部传感器去感知环境,利用算法和芯片处理器去识别环境,通过算法提供的智能化决策给汽车输入控制从而来实现自动驾驶的功能。

了解了自动驾驶实现的逻辑,我们需要考虑的是当前技术环境下实现自动驾驶发展的制约因素主要有哪些?

或者说目前在热门的无人驾驶赛道中,有哪些关键环节技术需要率先突破从而实现无人驾驶解决方案向着L3-L4-L5方向前进。

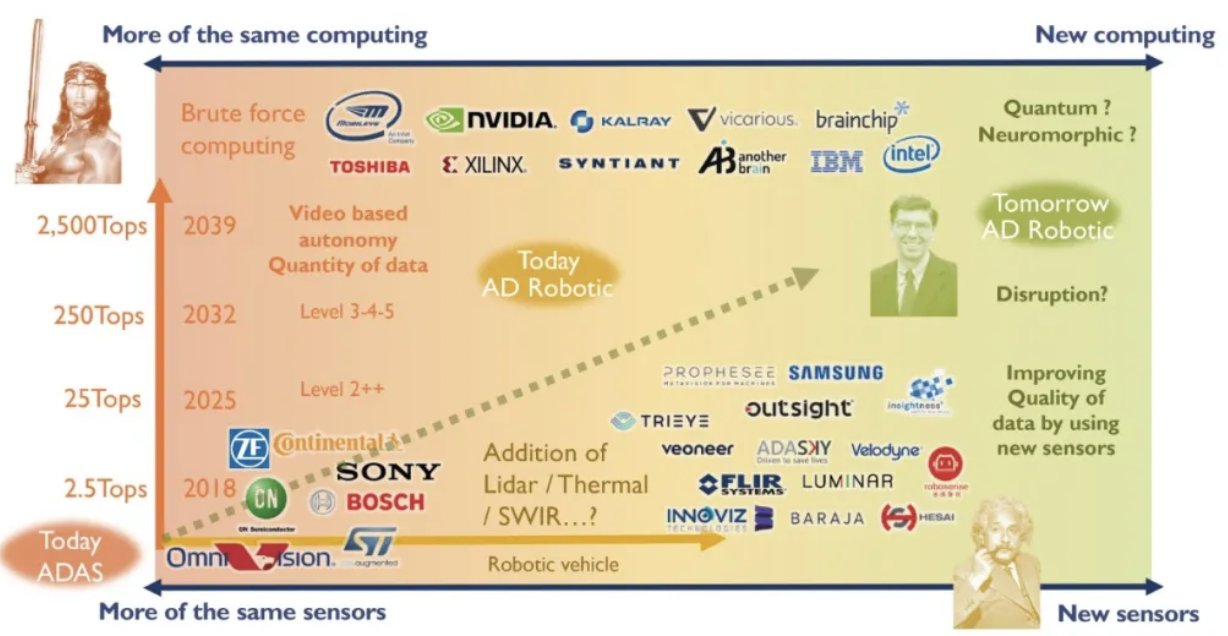

01超级人工智能(AI)处理器

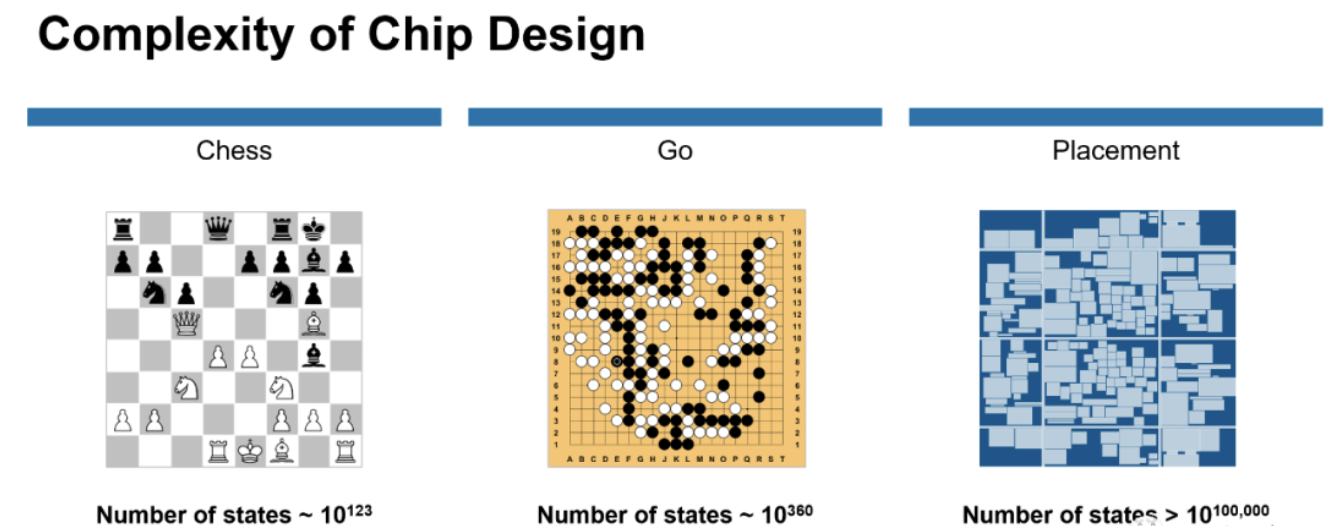

前文讲到,自动驾驶技术主要采用深度学习(deep learning)作为其核心逻辑引擎。而深度学习(deep learning)的核心是把物体进行微分化处理,微分处理后的“碎片信息”会被标识成不同的门类(参照物),经过对这些门类的再次微分化,使“碎片化”信息逐步从局部到整体的匹配识别。要完成这样不断分割、对比、标识、聚拢的复杂化流程,就需要异常强大的算力作为支撑。算力TOPS(Tera trillion" Operations Per Second) 表示每秒万亿次操作,它主要是对信息数据最大可实现吞吐量的度量,是当前最直观评价AI芯片的能力指标。

列几个目前市面有代表性的几家技术厂商的算力平台性能:

AI行业中的主要处理器类型有以下:

CPU(中央处理单元)是为通用计算目的而设计的芯片,着重于计算和逻辑控制功能。它们在处理单个复杂的计算顺序任务方面很强,但是在大规模数据计算方面却很差。

GPU(图形处理单元)最初设计用于图像处理,但已成功地用于AI。GPU包含数千个内核,并且能够同时处理数千个线程。这种并行计算设计使GPU在大规模数据计算中极为强大。

FPGA(现场可编程门阵列)是可编程逻辑芯片。这种类型的处理器在处理小规模但密集的数据访问方面功能强大。此外,FPGA芯片允许用户通过其微小的逻辑块对电路路径进行编程,以处理任何种类的数字功能。

ASIC(专用集成电路)是高度定制的芯片,专门设计用于在特定应用中提供卓越的性能。但是,定制的ASIC一旦投入生产,就无法更改。

其他芯片类型,例如神经形态处理单元(NPU),其结构可模仿人脑,具有在未来成为主流的潜力,但仍处于开发的早期阶段。

综上所述,当前主要影响全自动驾驶的阻碍是AI芯片的设计能力和制造能力以及强大5G网络基础设施全面构建。

02高精度高集成化传感器系统

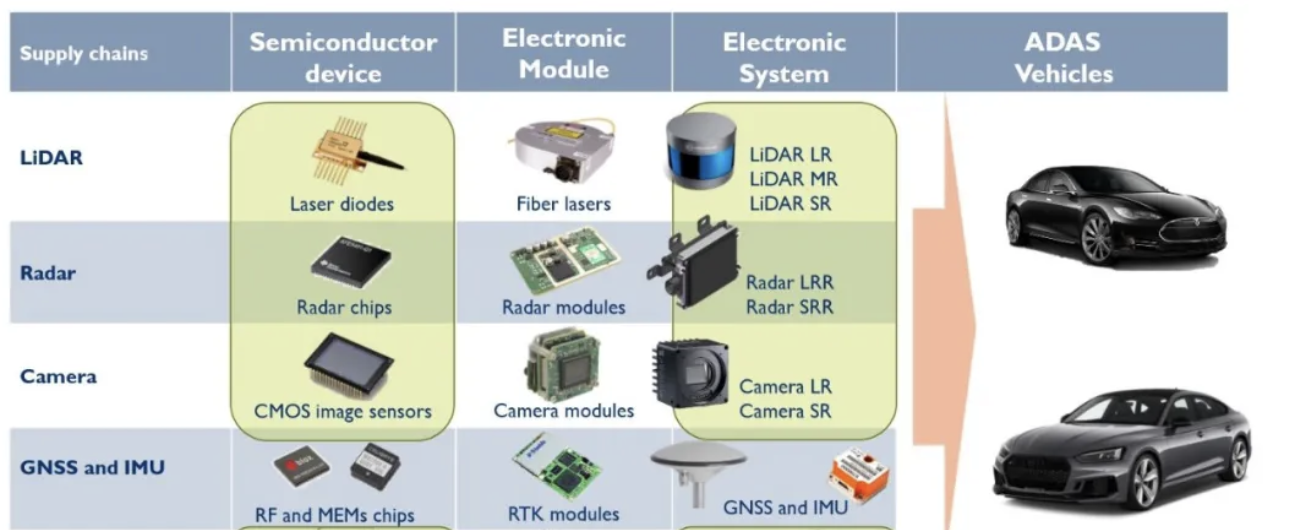

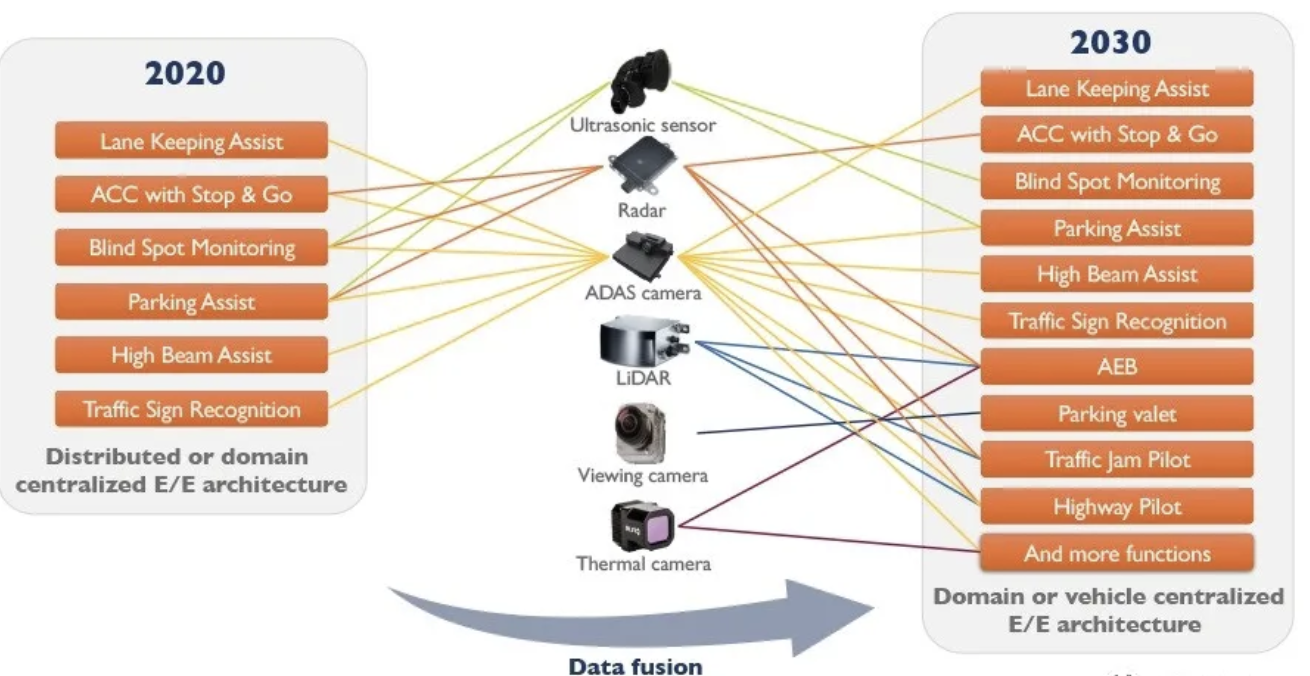

感知定位是自动驾驶的前提,当前汽车主要采用雷达来测量前车距离,采用摄像头来识别物体,采用IMU,GNSS来预测车辆运动状态。

未来自动驾驶解决方案将大规模采用激光雷达定位感知大部分障碍物,同时还会加入热成像技术来识别动物和夜间成像等。

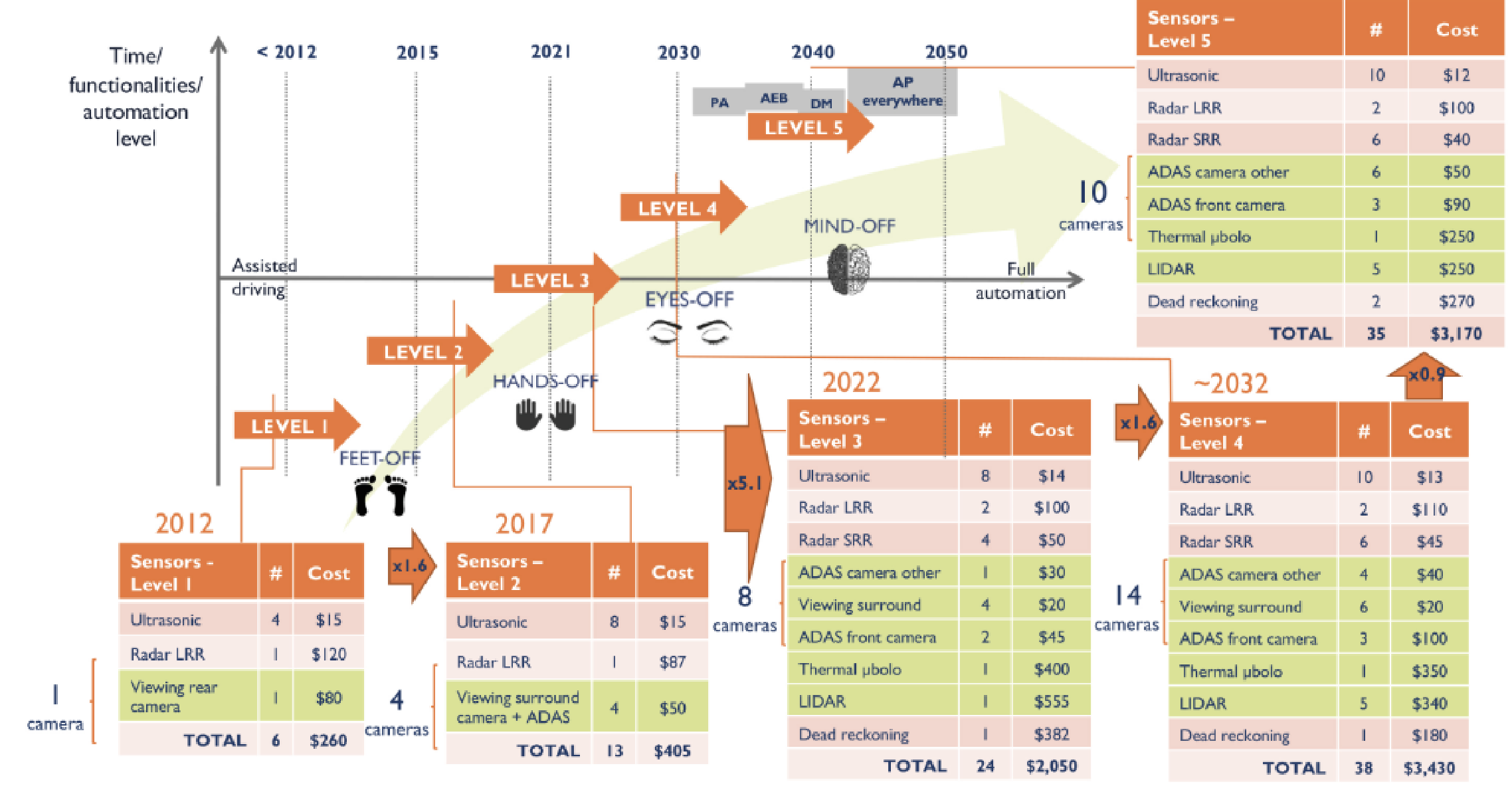

根据2021最新Yole的报告显示,未来实现自动驾驶整车上传感器的成本会是当前汽车上的传感器价格的8倍左右。

这些价格的增量部分主要来自于多种高精度传感器(包括激光雷达)的使用,车载大量的传感器精度与可靠度升级。此外,高集成度的传感器集合与可适配的整车布置会使得传感器与车载大灯和激光雷达的融合。最近大热的蔚来ET7车型所使用的自动驾驶雷达摄像头均布置在追求流线外形和低风阻设计车顶部分,这大大影响了美观和整车动力性能的设计。未来,高精度与集成的传感器系统将会解决车企这样的“尴尬”。

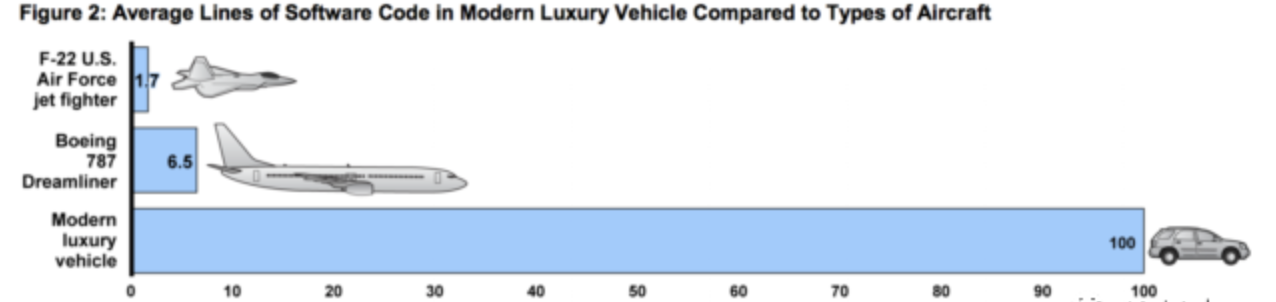

03自动驾驶软件及算法

需要说明的是,车载自动驾驶软件算法远比当前任何商用飞行器都复杂,汽车在实际驾驶的真实场景中所遇到的情况比飞机要复杂很多。随着汽车全球普及率越来越高,未来的城市郊区路况都将更加复杂多变。这也使得自动驾驶软件和算法需要不断迭代和极强的数据分析与决策能力。未来,无人驾驶方案对不断更新的算法和软件都提出了极高的要求。

04 车路协同V2X标准和生态的尽快建立

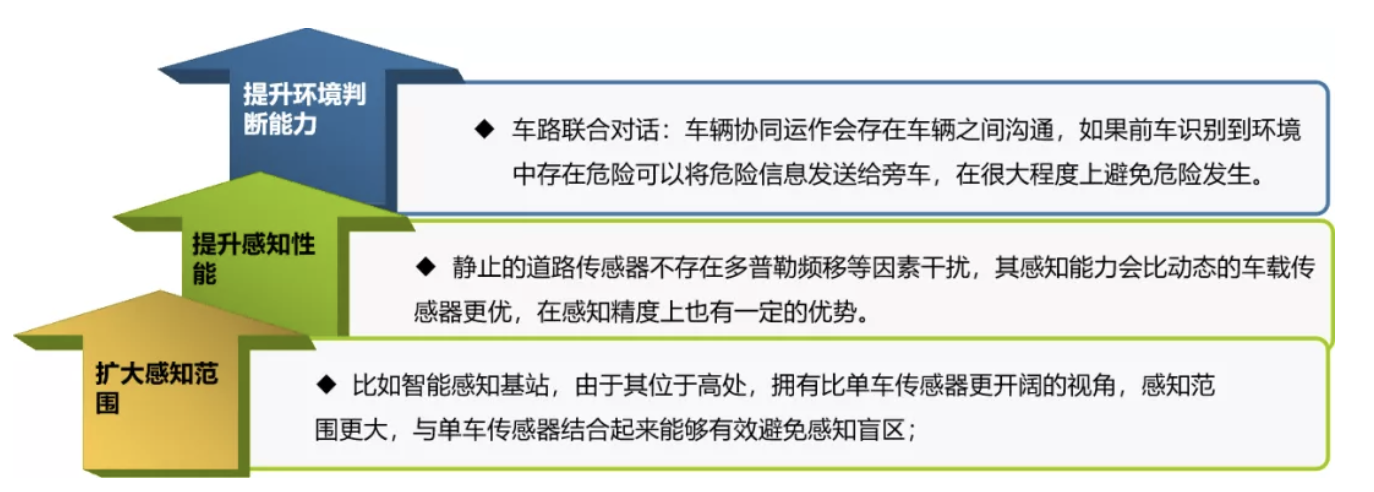

在实现自动驾驶的过程中,对于车端感知的自动驾驶器由于感知范围有限,感知性能上由于传感器自身存在的限制,可能导致感知性能暂时性降低甚至失效,仅靠单车的智能,很多典型的驾驶场景是无法满足安全驾驶需求的,这也是当前主机厂开发自动驾驶系统的痛点。

这就使得路端信息的加入是一个必需的过程。通过对部分主机厂已经量产的自动驾驶产品统计分析看出,L4在其限定的运行范围ODD内需要运行稳定安全,更多是需要路端软件配合车端软件进行优化。主机厂希望通过构建智慧的路以弥补车端感知缺陷,从而达到提高自动驾驶性能,降低成本的目的。

总结

自动驾驶技术的发展已经到了必须改造基础设施的阶段,要全面构筑“人-车-路”全域数据感知的智能路网,进入“聪明的车”与“智能的路”相互协同的新阶段。也就是说,从自主驾驶转向车路协同。可以先对简单相对固定的场景进行路端改造。

比如乘用车行驶路线因个人和时间的不同而不同,短期内难以大面积铺开。但对固定物流路线改造则相对容易,由于使用率高,边际成本将大大降低。对于广泛应用的小汽车,自主驾驶的技术路线更为可能和现实。当然,对于城市公交和矿区、码头的搬运车辆等,由于固定线路和特定区域,可充分利用车路协同技术的优势。